Anthropic hält Mythos zurück — aber warum wirklich?

Anthropic verkauft die Bremse beim Mythos-Release als Sicherheitsmaßnahme. TechCrunch fragt offen: Geht es um Cybersecurity — oder um Schadensbegrenzung für Anthropic selbst?

Die offizielle Version

Anthropic argumentiert mit echten Risiken. Mythos sei zu mächtig, um es unkontrolliert rauszuhauen. Cybersecurity-Bedenken, möglicher Missbrauch, das volle Programm.

Klingt vernünftig. Klingt nach verantwortungsvollem AI-Lab.

Was TechCrunch zwischen den Zeilen liest

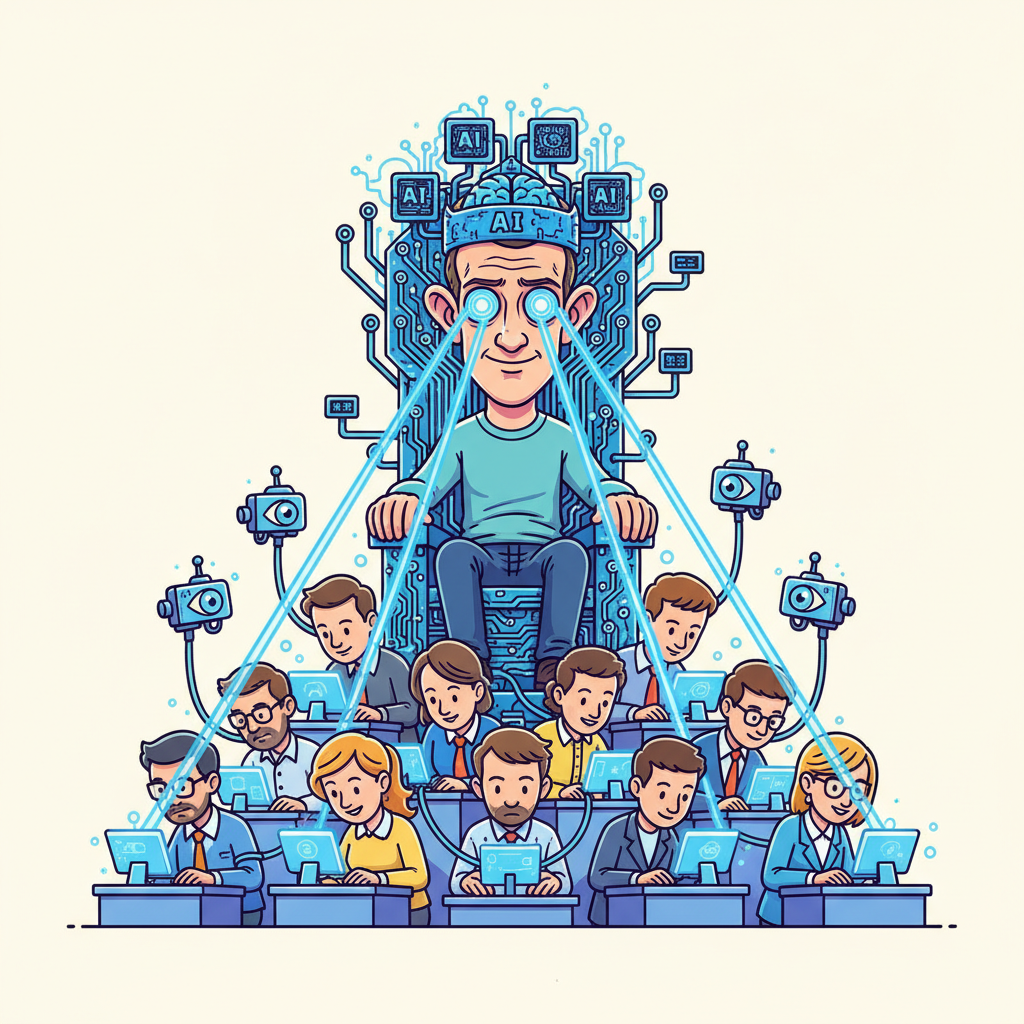

Die Frage ist brutal einfach: Schützt Anthropic das Internet — oder sich selbst? Wenn ein Modell intern Probleme zeigt, ist ein limitierter Release auch ein PR-Schutzschild. Kein öffentlicher Zugang heißt: keine öffentlichen Benchmarks, keine peinlichen Fails auf Twitter.

✅ Pro

- Anthropic nimmt Safety ernster als die meisten Labs

- Kontrollierter Rollout kann echte Schäden verhindern

- Transparenz über die Entscheidung existiert zumindest teilweise

❌ Con

- Keine unabhängige Überprüfung der Sicherheitsbedenken

- Wettbewerbsvorteil durch Geheimniskrämerei

- Vertrauen braucht mehr als Pressemitteilungen

Was das bedeutet

Die ganze AI-Branche steckt in einem Dilemma. Wer Modelle zurückhält, wird als verantwortungsvoll gefeiert — oder als strategisch. Von außen lässt sich das kaum unterscheiden. Anthropic muss liefern: entweder Mythos öffentlich machen oder die Bedenken konkret und nachprüfbar offenlegen.