🔥 HOT NEWS

DeepSeek V4 läuft auf Huawei-Chips

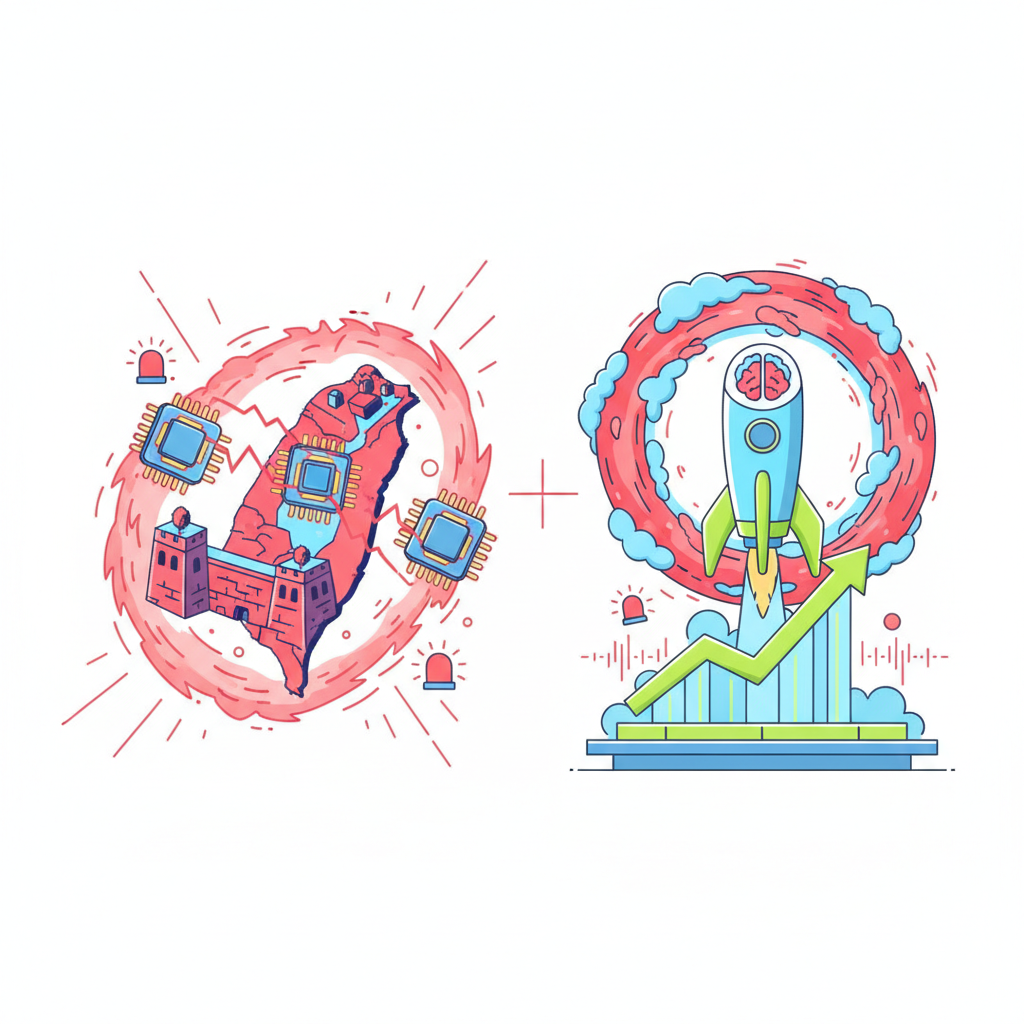

China zeigt dem Westen den Mittelfinger. DeepSeek hat zwei neue Modelle veröffentlicht — offen, billig und komplett ohne westliche Hardware.

China zeigt dem Westen den Mittelfinger. DeepSeek hat zwei neue Modelle veröffentlicht — offen, billig und komplett ohne westliche Hardware.

Was drin steckt

- Modelle:** DeepSeek-V4, zwei Versionen

- Lizenz:** Open — Gewichte frei verfügbar

- Inference-Hardware:** Huawei Ascend AI-Chips

- Preis:** Deutlich günstiger als westliche Konkurrenz

Warum Huawei alles ändert

Die USA haben Nvidia-Exports nach China gedeckelt. Sollte Pekings KI-Ambitionen bremsen. Hat es nicht. DeepSeek umgeht die Sanktionen komplett — mit chinesischen Chips von Huawei statt H100s von Nvidia.

Das ist kein Workaround. Das ist eine parallele Infrastruktur.

Was das bedeutet

Die westliche Annahme war simpel: Ohne unsere Chips kein KI-Fortschritt. DeepSeek V4 widerlegt das zum wiederholten Mal. Wenn Open-Weight-Modelle auf Huawei-Hardware konkurrenzfähig laufen, verlieren US-Exportkontrollen ihren wichtigsten Hebel.

✅ Pro

- Open Weights — jeder kann es nutzen und anpassen

- Günstige Inference senkt die Einstiegshürde weltweit

- Beweis, dass KI nicht an Nvidia gebunden sein muss

❌ Con

- Huawei-Chips sind im Westen schwer verfügbar

- Benchmarks und echte Performance noch abzuwarten

- Geopolitische Abhängigkeit dreht sich nur um — nicht weg

🤖 NERDMAN-URTEIL

Die Sanktions-Strategie der USA ist gescheitert — DeepSeek baut mit Huawei-Chips einfach sein eigenes Ökosystem, und der Rest der Welt schaut zu.

Quelle: AI Business

War dieser Artikel hilfreich?

Dein Feedback hilft uns, bessere Artikel zu liefern.