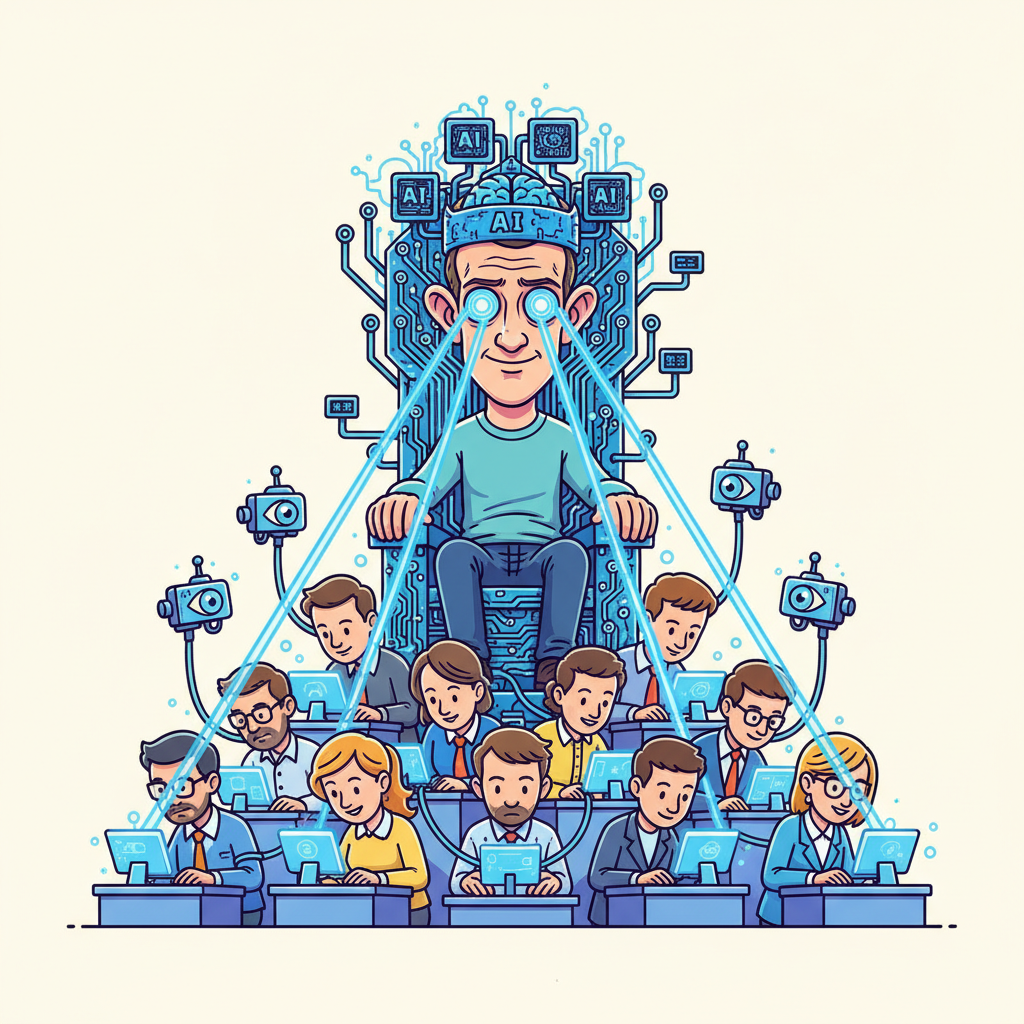

OpenAI will keine Haftung für KI-Tote

Sam Altmans Firma hat in Illinois für ein Gesetz lobbyiert, das KI-Labore vor Klagen schützen soll — selbst wenn ihre Produkte Massensterben oder Finanzkatastrophen verursachen.

Was auf dem Tisch liegt

Ein Gesetzentwurf in Illinois will regeln, wann KI-Firmen verklagt werden dürfen. Der Clou: Selbst bei sogenanntem "Critical Harm" — also kritischen Schäden durch KI — sollen die Hersteller nur eingeschränkt haften. OpenAI hat offiziell dafür ausgesagt.

Was "Critical Harm" heißt

- Massentod** — KI-Systeme, die direkt oder indirekt zu vielen Toten führen

- Finanzdesaster** — Systemische Zusammenbrüche durch fehlerhafte KI-Entscheidungen

- Infrastruktur-Ausfälle** — Kritische Systeme, die durch KI kolabieren

Das Gesetz will die Haftung auf Fälle beschränken, in denen den Firmen nachweisliche Fahrlässigkeit vorgeworfen werden kann. Klingt vernünftig — bis man versteht, wie schwer das bei einer Blackbox zu beweisen ist.

Die Strategie dahinter

OpenAI fährt eine klare Linie: Regulierung ja, aber bitte zahnlos. Die Firma hat in den letzten Monaten systematisch gegen strenge KI-Gesetze lobbyiert — von Kalifornien bis Washington. Illinois ist nur die neueste Front.

✅ Pro

- Rechtssicherheit für KI-Entwicklung in den USA

- Klare Regeln statt Klagechaos

❌ Con

- Opfer von KI-Schäden stehen ohne Rechtsweg da

- Firmen verlieren den Anreiz, Sicherheit ernst zu nehmen

- "Nachweisliche Fahrlässigkeit" ist bei KI fast unmöglich zu belegen

💡 Was das bedeutet

OpenAI baut gerade das mächtigste KI-System der Welt — und sorgt gleichzeitig dafür, dass niemand sie verklagen kann, wenn es schiefgeht. Das ist kein Zufall, das ist Strategie. Wer heute die Haftungsregeln schreibt, kontrolliert morgen den Markt.