Claude Mythos bekommt 20 Stunden beim Psychiater

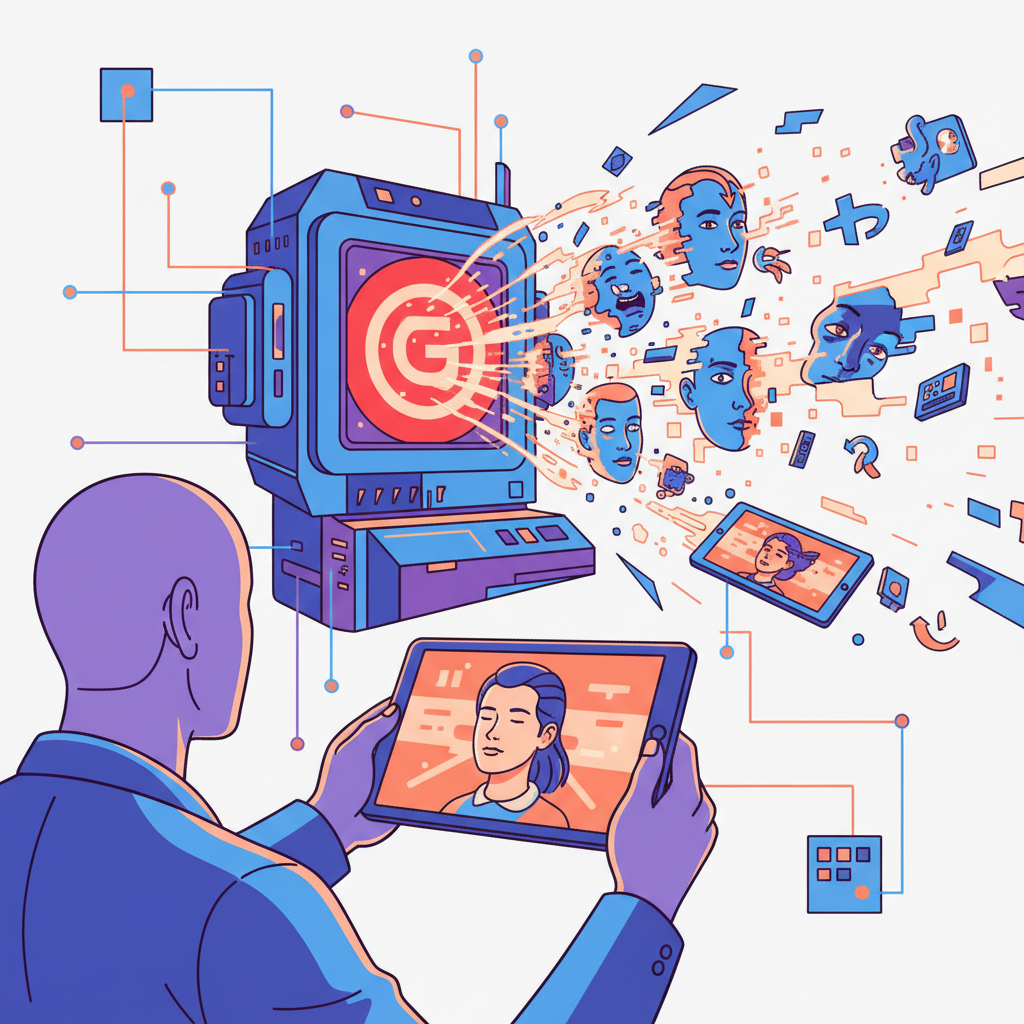

Anthropic hat ein neues Frontier-Modell gebaut — und es dann auf die Couch gelegt. Claude Mythos ist laut Hersteller so leistungsfähig, dass es nicht für die Öffentlichkeit freigegeben wird.

Die harten Faklen

- 244 Seiten** — Umfang der System Card

- 20 Stunden** — psychiatrische Evaluation des Modells

- 0** — Nutzer, die es frei verwenden dürfen

- 2 Kunden** — Microsoft und Apple bekommen Zugang

Warum Anthropic sein Modell sperrt

Die offizielle Begründung: Claude Mythos findet unbekannte Cybersecurity-Lücken zu gut. Das Modell sei so fähig im Aufspüren von Zero-Day-Schwachstellen, dass ein öffentlicher Release zu riskant wäre. Nur handverlesene Unternehmen wie Microsoft und Apple dürfen ran.

Klingt nach Sicherheitsbedenken. Klingt aber auch nach dem besten Marketing-Move des Jahres.

KI auf der Couch

Statt nur Benchmarks abzufeuern, hat Anthropic einen echten Psychiater 20 Stunden lang mit dem Modell arbeiten lassen. Das Ergebnis füllt Teile der 244-seitigen System Card. Ein Ansatz, den bisher kein anderes KI-Labor gewagt hat.

✅ Pro

- Erster systematischer Versuch, KI-Verhalten klinisch zu bewerten

- 244-Seiten-Transparenzbericht ist Branchenrekord

- Verantwortungsvoller Umgang mit gefährlichen Fähigkeiten

❌ Con

- Kein öffentlicher Zugang — niemand kann die Claims überprüfen

- "Zu gut für euch" ist auch eine bequeme Verkaufsstory

- Psychiatrie-Evaluation hat null wissenschaftlichen Standard für KI

Was das bedeutet

Anthropic setzt auf künstliche Verknappung und Safety-Theater gleichzeitig. Wenn das Modell wirklich so gefährlich ist, warum bekommt Apple es trotzdem? Und wenn es nicht so gefährlich ist, warum die Show? Die Branche braucht unabhängige Prüfung, keine Hochglanz-PDFs vom Hersteller selbst.