Google zwingt Bildgeneratoren zum Sehen

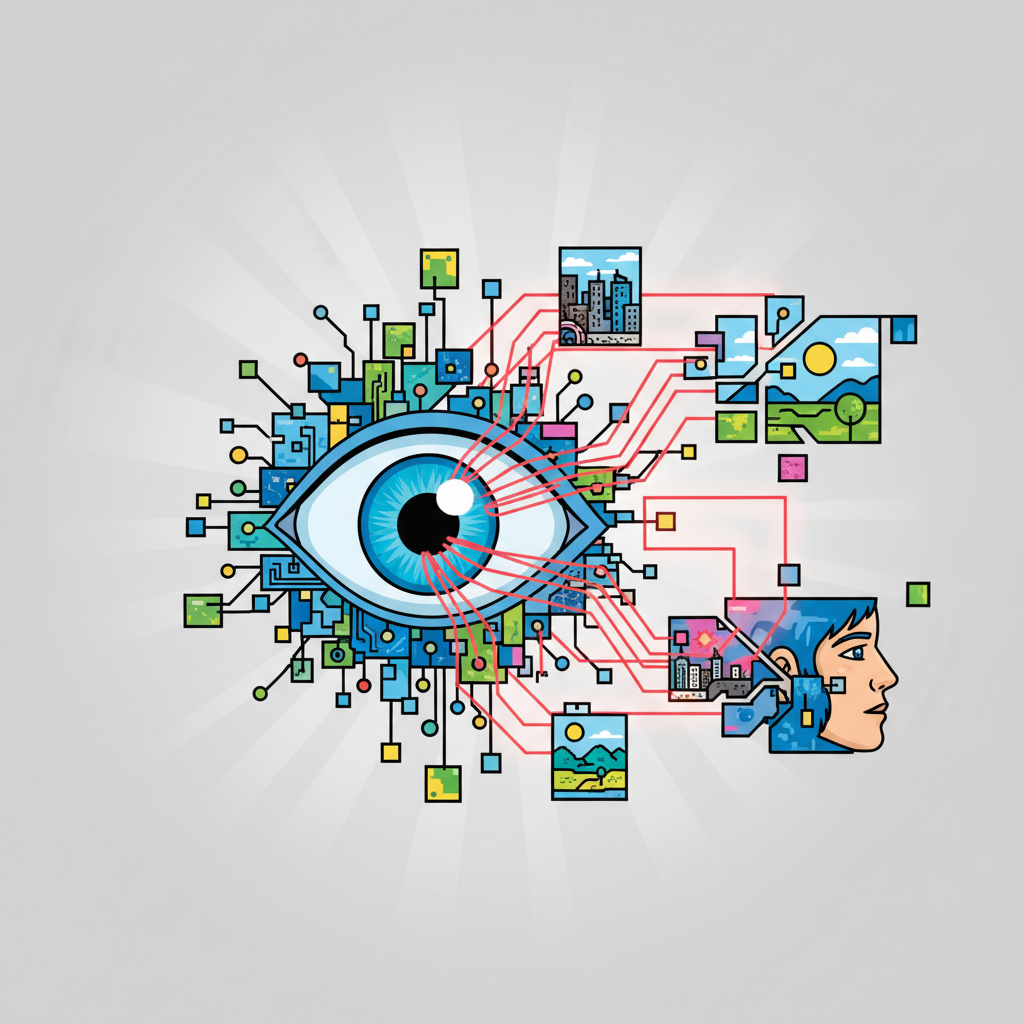

Ein Modell, das Bilder erzeugt UND versteht — Google DeepMind hat mit Vision Banana die Mauer zwischen generativen und diskriminativen Vision-Modellen eingerissen.

Die alte Regel ist tot

Jahrelang galt in der Computer-Vision-Welt ein ungeschriebenes Gesetz: Modelle, die Bilder erzeugen, können sie nicht verstehen. Und umgekehrt. Zwei getrennte Welten, zwei getrennte Forschungszweige. Google DeepMind sagt: Quatsch.

Was Vision Banana macht

Das Paper "Image Generators are Generalist Vision Learners" (arXiv:2604.20329, veröffentlicht am 22. April 2026) zeigt einen instruction-tuned Bildgenerator, der gleichzeitig als Vision-Allrounder funktioniert. Ein Modell. Mehrere Disziplinen. Keine Kompromisse.

Zahlenbox

- Segmentation:** Schlägt SAM 3 — Metas bisherigen Goldstandard

- Tiefenschätzung:** Übertrifft Depth Anything V3 bei metrischer Depth Estimation

- Architektur:** Instruction-tuned Image Generator als Basis

- Team:** Google DeepMind Research

Warum das wichtig ist

💡 Was das bedeutet

Bisher brauchte man für jede Vision-Aufgabe ein spezialisiertes Modell. Segmentierung? SAM. Tiefenschätzung? Depth Anything. Bildgenerierung? Imagen. Vision Banana vereint das in einer Architektur. Wenn Generatoren gleichzeitig die besten Analysten sind, wird die halbe Vision-Pipeline überflüssig.

✅ Pro

- Ein Modell statt drei — weniger Infrastruktur, weniger Kosten

- Schlägt Spezialisten auf deren eigenem Terrain

- Öffnet neue Forschungsrichtung für Multimodal-Architekturen

❌ Con

- Noch ein Paper — kein öffentliches Modell angekündigt

- Google-exklusiv, Open-Source-Status unklar

- Der Name "Banana" ist... eine Wahl