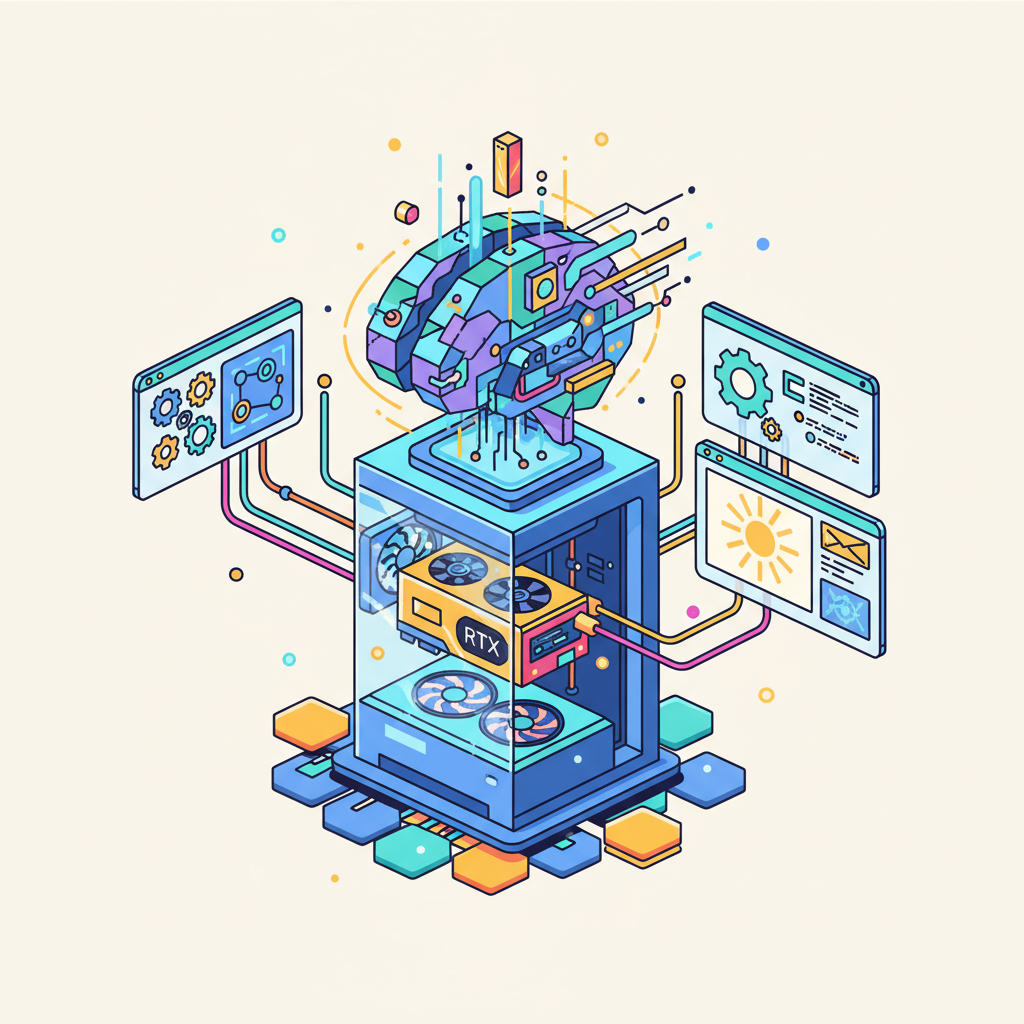

Gemma 4 läuft jetzt lokal auf RTX

Google und NVIDIA machen gemeinsame Sache. Ergebnis: Gemma 4 rennt direkt auf der Grafikkarte — ohne Cloud, ohne Umwege.

Was konkret passiert ist

Google hat die Gemma-4-Familie vorgestellt. Kleine, schnelle Modelle, gebaut für lokale Ausführung. NVIDIA hat sie für RTX-Grafikkarten optimiert — über das hauseigene "RTX AI Garage"-Programm.

Der Clou: Die Modelle sind omni-capable. Text, Bild, Kontext — alles auf dem eigenen Rechner. Kein API-Call nötig.

Warum lokal wichtig ist

Agentic AI braucht Echtzeit-Kontext. Dateien auf der Festplatte, offene Tabs, laufende Prozesse. Cloud-Modelle sehen davon nichts.

Gemma 4 soll genau diese Lücke schließen. Direkt auf dem Gerät, direkt am Geschehen. NVIDIA liefert die Hardware-Beschleunigung dazu.

✅ Pro

- Open Model — jeder kann es nutzen und anpassen

- Läuft lokal, Daten bleiben auf dem Rechner

- Optimiert für Consumer-GPUs (RTX-Serie)

- Agentic-AI-fähig ohne Cloud-Abhängigkeit

❌ Con

- Qualität kleiner Modelle bleibt hinter Cloud-Giganten zurück

- RTX-Pflicht schließt AMD und Intel aus

- Konkrete Benchmarks? Fehlanzeige in der Ankündigung

💡 Was das bedeutet

Zwei Tech-Giganten schieben gemeinsam den Trend zu lokaler KI an. Wenn Gemma 4 auf einer RTX 4060 brauchbar läuft, wird "AI on device" vom Marketing-Sprech zur Realität. Für Entwickler heißt das: Agenten bauen, die wirklich mit dem lokalen System interagieren — ohne Latenz, ohne Datenschutz-Kopfschmerzen.