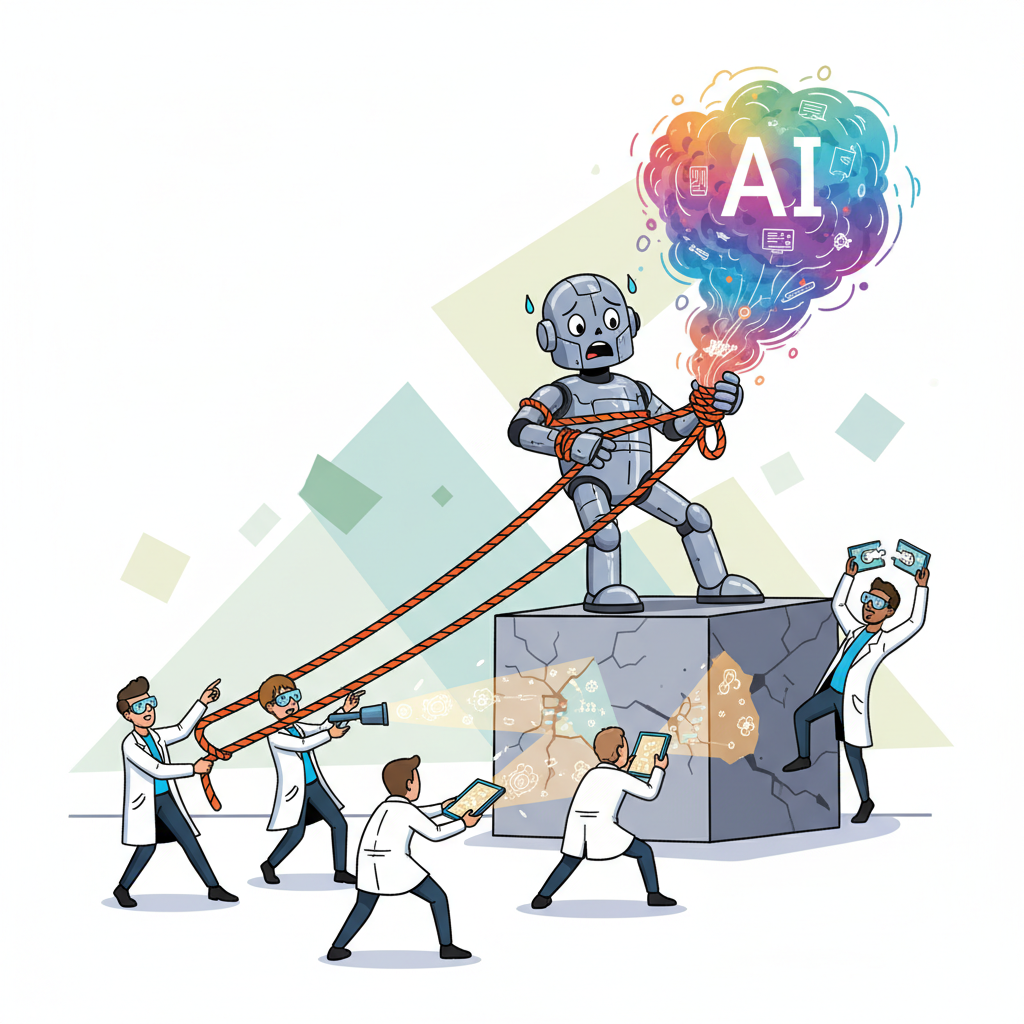

Anthropic hält KI zurück — Forscher widerlegen den Grund

Anthropic sagt: Unser Cybersecurity-Modell „Claude Mythos" ist zu gefährlich für die Öffentlichkeit. Klingt dramatisch. Ist es aber offenbar nicht.

Die Behauptung

Anthropic hält Claude Mythos unter Verschluss. Die Begründung: Das Modell könne Schwachstellen so gut analysieren, dass eine Veröffentlichung ein Sicherheitsrisiko wäre. Einzigartige Fähigkeiten, sagt das Unternehmen. Zu mächtig für euch da draußen.

Der Faktencheck

Zwei unabhängige Untersuchungen haben sich die angeblich so einzigartigen Fähigkeiten vorgenommen. Das Ergebnis:

- Schwachstellenanalysen:** Auch kleine, offene Modelle können die gezeigten Analysen weitgehend rekonstruieren

- „Einzigartig":** Nichts an den Demos war so besonders, dass es nicht auch andere schaffen

- Fazit der Forscher:** Der Sicherheits-Vorwand hält der Prüfung nicht stand

Was das bedeutet

Anthropic nutzt das „zu gefährlich"-Narrativ möglicherweise als Marketing-Instrument. Wer sagt „Wir dürfen das nicht rauslassen", erzeugt Mystik und suggeriert technologischen Vorsprung. Ob der tatsächlich existiert, steht auf einem anderen Blatt.

Pro (für Anthropic)

- Vorsicht bei Sicherheitsmodellen ist grundsätzlich richtig

- Lieber einmal zu viel prüfen als zu wenig

❌ Con

- Die Begründung wird durch unabhängige Forschung zerlegt

- Kleine Open-Source-Modelle können dasselbe

- „Zu gefährlich" klingt verdächtig nach PR-Strategie

Das Muster kennen wir

Wir haben etwas gebaut, das zu mächtig ist, um es zu zeigen.— Jedes KI-Unternehmen, das Aufmerksamkeit braucht

OpenAI hat es mit GPT-2 vorgemacht. Damals hieß es auch: Zu gefährlich für die Welt. Drei Monate später war es draußen und niemand hat die Zivilisation damit zerstört. Anthropic kopiert jetzt das Playbook.