Südafrika lässt KI seine KI-Regeln erfinden

Südafrika hat seinen nationalen KI-Policy-Entwurf zurückgezogen. Der Grund: Das Papier zitiert Quellen, die nie existiert haben — weil ein Chatbot sie frei erfunden hat.

Was passiert ist

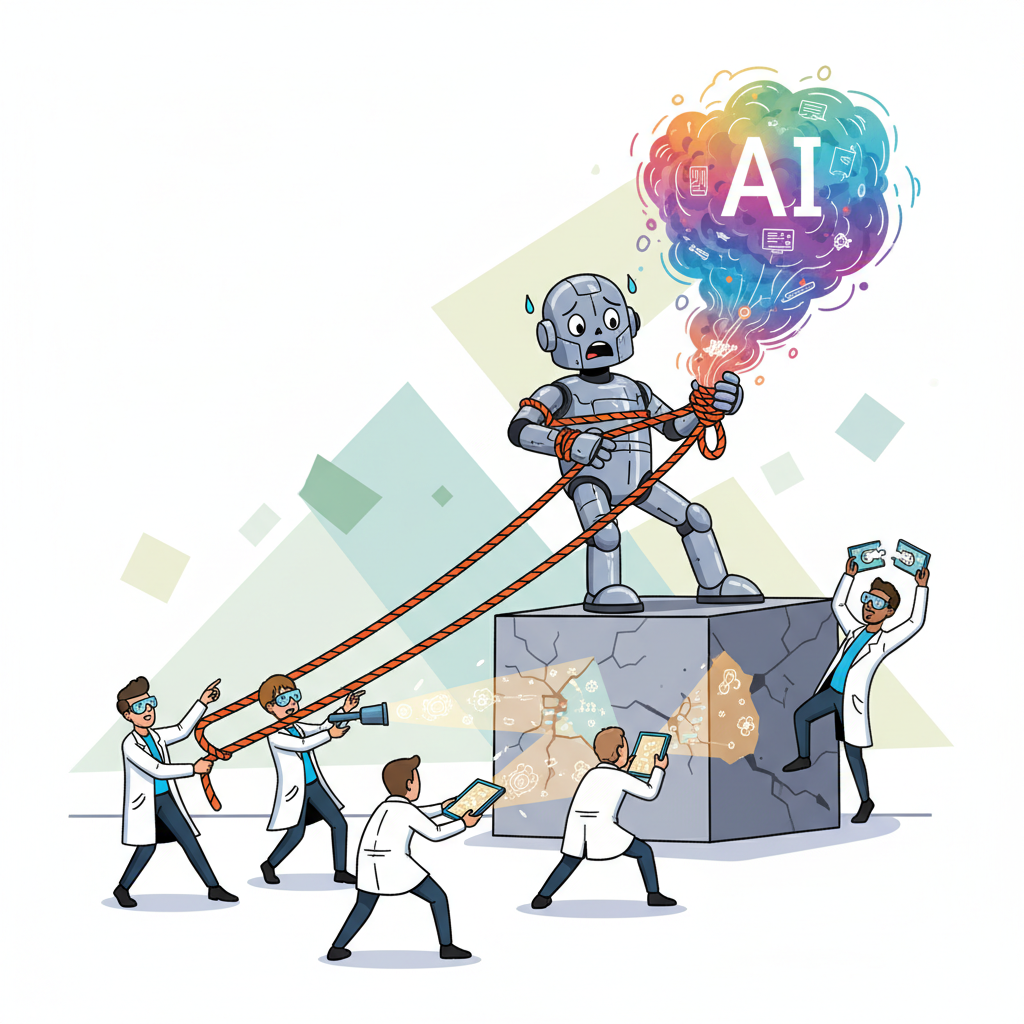

Die südafrikanische Regierung wollte Regeln für den Umgang mit Künstlicher Intelligenz aufstellen. Gute Idee. Dann haben sie eine KI benutzt, um beim Schreiben zu helfen. Schlechte Idee.

Das Ergebnis: Ein offizielles Policy-Dokument voller halluzinierter Quellen. Studien, die es nicht gibt. Referenzen aus der fruchtbaren Fantasie eines Chatbots. Ein Regelwerk für KI-Nutzung, das selbst der beste Beweis gegen unkontrollierte KI-Nutzung ist.

Der Faktencheck

- Problem:** Erfundene Zitate in einem offiziellen Regierungsdokument

- Ursache:** KI-gestütztes Drafting ohne menschliche Überprüfung

- Reaktion:** Kompletter Rückzug des Entwurfs

- Peinlichkeitsfaktor:** Maximal — ausgerechnet die KI-Policy fällt auf KI-Halluzinationen rein

💡 Was das bedeutet

Das ist kein Randfall. Das ist ein Regierungsdokument, das die Zukunft von KI in einem ganzen Land regeln sollte — und niemand hat die Quellen geprüft, bevor es veröffentlicht wurde. Wer KI für Policy-Arbeit einsetzt, ohne die Ergebnisse zu verifizieren, hat das Werkzeug nicht verstanden.

✅ Pro

- Südafrika hat den Fehler erkannt und reagiert

- Der Rückzug zeigt: Selbstkorrektur funktioniert

❌ Con

- Ein ganzer Regierungsapparat hat halluzinierte Quellen durchgewunken

- Das Vertrauen in KI-Regulierung aus diesem Haus ist erstmal weg

- Der Vorfall liefert KI-Skeptikern Munition für Jahre