🏆 TOOLS

OpenAI bringt Stimme ins API

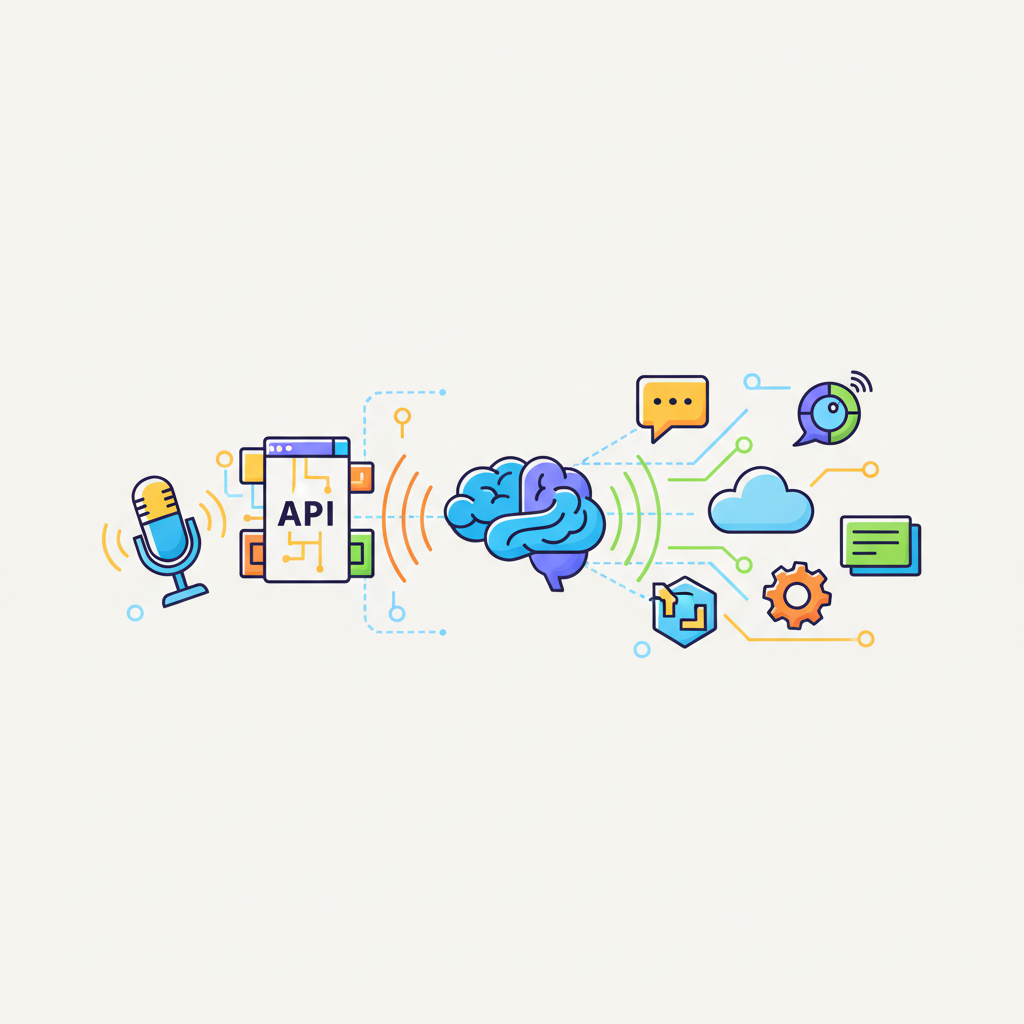

OpenAI dreht an der Voice-Schraube. Neue Voice-Intelligence-Features landen ab sofort im API — und sollen weit mehr können als Callcenter beschallen.

OpenAI dreht an der Voice-Schraube. Neue Voice-Intelligence-Features landen ab sofort im API — und sollen weit mehr können als Callcenter beschallen.

Was drin ist

- Voice Intelligence:** neue API-Features für Stimm-Verarbeitung

- Zielgruppe:** Customer-Service-Systeme zuerst, dann Bildung und Creator-Plattformen

- Verfügbarkeit:** direkt über die OpenAI-API

- Use Cases:** alles wo Stimme rein- oder rausgeht

✅ Pro

- Direkt im bestehenden API verfügbar — kein neuer Stack nötig

- Breiter Einsatz: Support, Lernen, Creator-Tools

- OpenAI-Voice ist seit GPT-4o der Maßstab für Latenz

❌ Con

- Kein Benchmark, keine Demo, keine Zahlen

- Preise? Schweigen.

- "Customer Service" als erstes Beispiel — kreativ ist anders

- Konkurrenz von ElevenLabs und Deepgram schläft nicht

💡 Was das bedeutet

Wer Voice-Apps baut, muss jetzt nicht mehr drei Anbieter zusammenflicken. OpenAI zieht die Voice-Pipeline ins eigene API — Speech-to-Text, Reasoning und Output aus einer Hand. Für Indie-Devs heißt das: weniger Glue-Code, mehr Marge.

🤖 NERDMAN-URTEIL

Solides Update, aber ohne harte Zahlen klingt's nach Marketing — zeig uns die Latenz, dann reden wir.

Quelle: TechCrunch AI

War dieser Artikel hilfreich?

Dein Feedback hilft uns, bessere Artikel zu liefern.